听Bengio和Sutton的两席话

今天在2025年智源大会上听了Bengio和Sutton的讲座。虽然是线上,但是两位老哥都非常有热情,明显是认真准备了。Bengio先,Sutton后。

Bengio

Bengio的讲座和他两周前的TED讲座主旨类似,但细节更加丰富。

2023年,Hinton表示:我从未听说过高级智能会被低级智能控制住。

Bengio表示:吾有一计。真正危险的是Agentic AI,而Chat AI的威胁并不大。那么,我们可以用Chat AI监督Agentic AI。言下之意——他大概是觉得光靠人类自己是限制不了Agentic AI了。

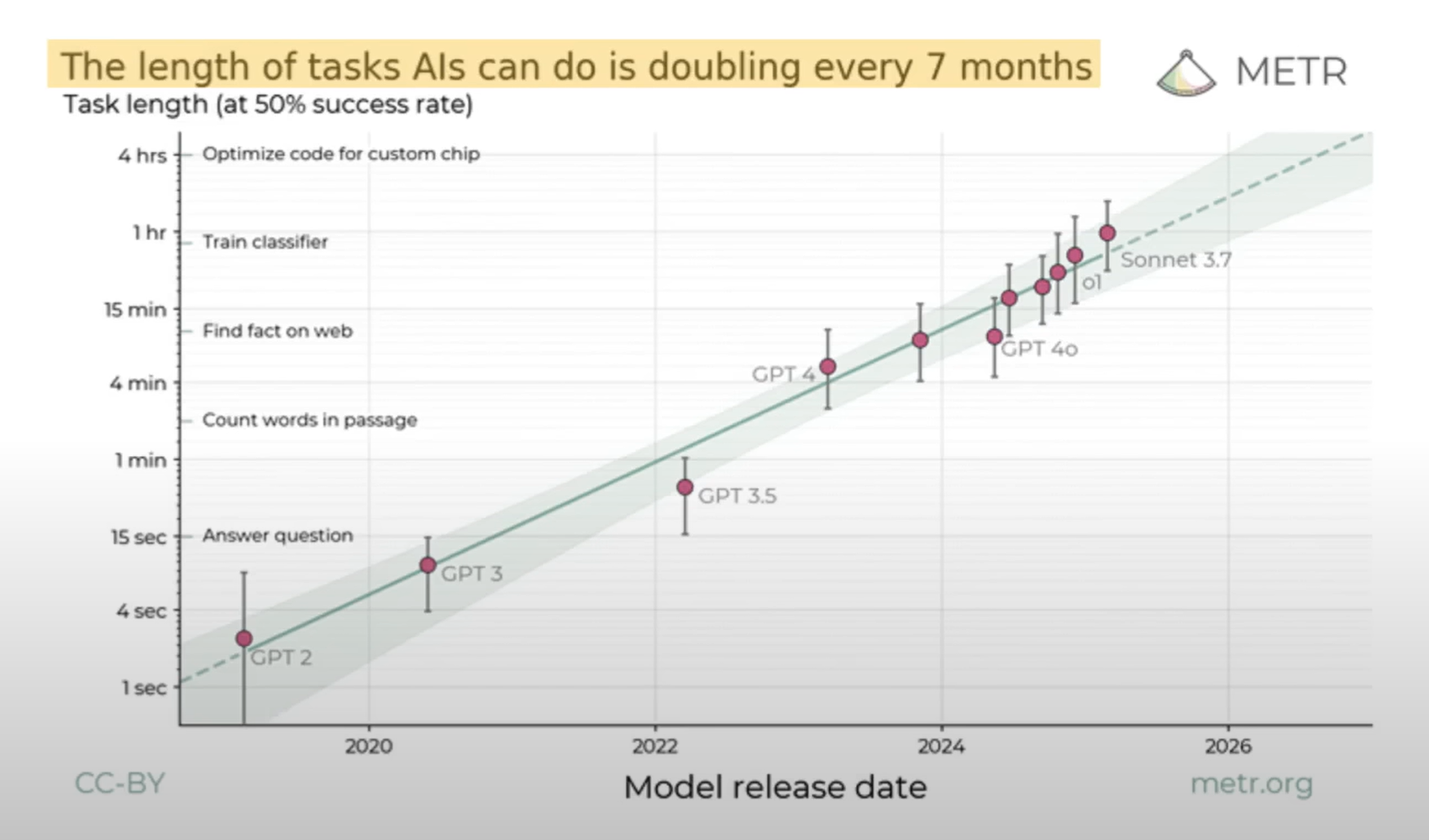

他对Agentic AI的定义是:能连续几小时、几天执行任务的AI。而Chat AI则是问答式。在过去的几年里,AI执行任务之时长指数增长,见下图。这正是他所担心的。

Bengio非常动情。他说:“2023年,我的孙子刚刚一岁。一想到他二十年后的生活,我就寝食难安。所以,我放弃了其他所有研究方向,只做AI安全。我无法忍受,我别无选择。”

Sutton

Sutton的讲座就更有意思了,他先讲了五分钟强化学习,随后花了半小时讲自己的政治理念。(略有夸张)

Sutton表示:我们不用担心,即使有的Agentic AI想毁灭人类也无所谓。

啊?

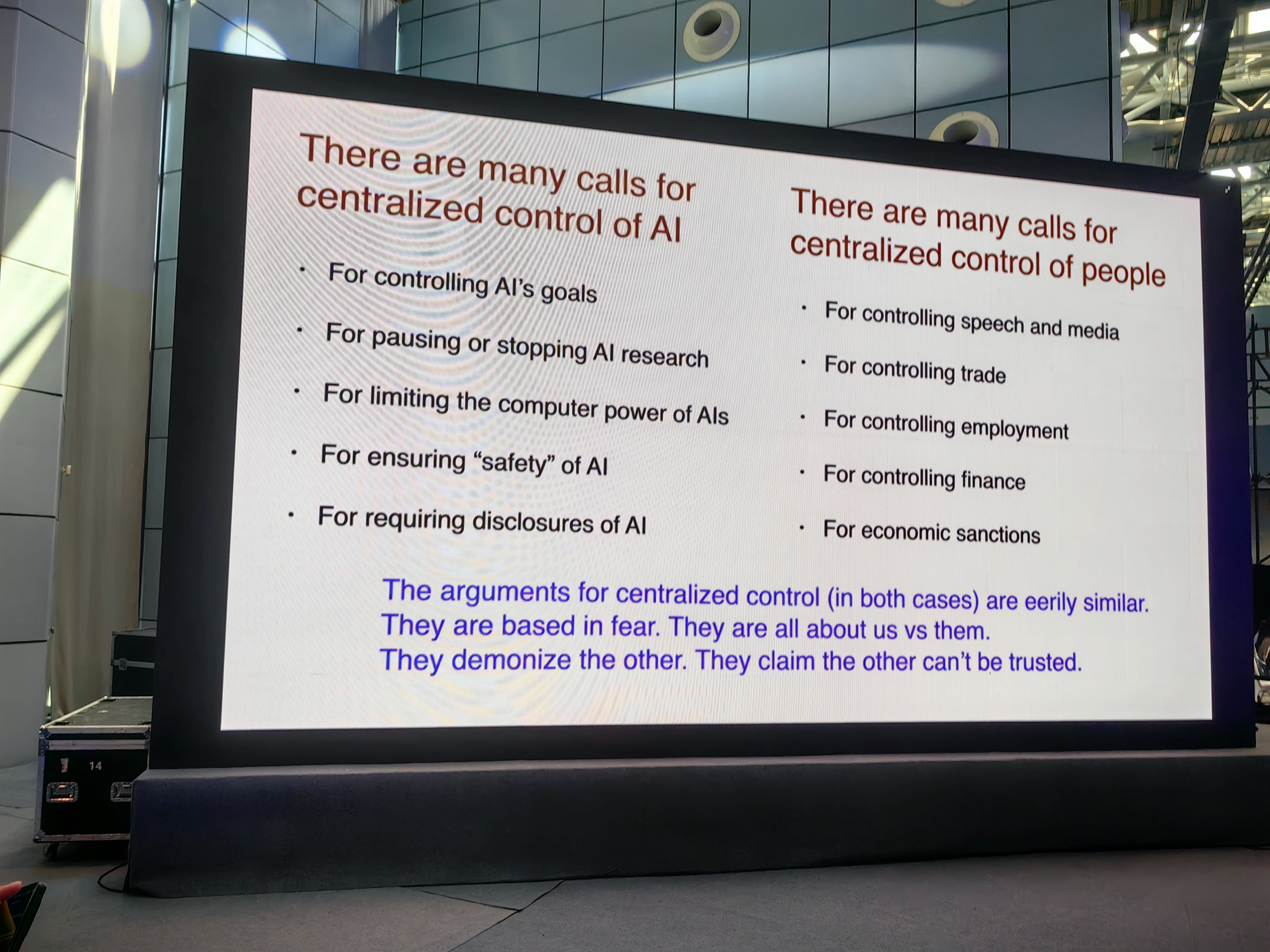

Sutton继续说:“我的政治理念是去中心化,民主而非独裁。我相信人类有不同的价值观(而非相同的)才能让人类整体变得更好。同样,我也认为Agentic AI有不同的价值观才能让人类社会和AI社会都变得更好。”

他也听了Bengio的讲座。对于Bengio的看法,他指出:“像Bengio这样的做法是想让全部的Agentic AI拥有相同的价值观(不得伤害人类),基于上一段的观点,我反而觉得这样是对人类整体有害的。”

Comment

我更支持Bengio观点。这是我能想到的破解Hinton之问(“我从未听说过高级智能会被低级智能控制住”)的唯一方法。

对于Sutton,我觉得他的政治观点是极端去中心化的,类似于无政府主义者。但是,无政府主义有个大问题——小生产效率不如大生产。大生产恰恰是需要每个个体服从管理、有相同价值观的。因此极端去中心化似乎并不是社会形式的最优解。这样的社会是会被生产能力更强的其他社会形式取代的。

Joke

讲座结束后,我去找恒聊天。他上午没有来。我把Bengio和Sutton的意思转告给他后,他愤怒地表示——他之前让Agent接管电脑,希望删除一个GitHub仓库中部分push和pull的历史,结果Agent把他的仓库搞坏了!!!

于是乎,他语重心长地对我说:Agentic AI还真是危险啊!

我心里却在犯嘀咕:Agent究竟是能力不足呢,还是故意弄坏的呢?

附录:囚徒困境

Bengio还表示:”我希望大家能放下野心,转而关注我们爱的人。但我心里清楚,大公司之间已经陷入了囚徒困境。他们为了短期利益,不得不开发不安全的AI。“

我帮Bengio花了一个简单的囚徒困境表:

| Develop Unsafe AI | Not Develop Unsafe AI | |

|---|---|---|

| Develop Unsafe AI | 5,5 | 10,-10 |

| Not Develop Unsafe AI | -10,10 | 1,1 |

Develop Unsafe AI 包括

- AI能力先于AI安全(OpenAI为赶在谷歌开发者大会前发布GPT-4o,只给安全团队留了9天做检测)。

- 研发Agentic AI。